Содержание:

Главная задача любой поисковой системы – дать правильный ответ на вопрос пользователя, то есть, предоставить ему ссылку на наиболее релевантные страницы. На первый взгляд, задача может показаться простой, но если вспомнить про десятки миллионов сайтов и миллиарды страниц, она становится очень сложной. Ведь из этого многообразия нужно выбрать только то, что удовлетворит запрос пользователя. Любой оптимизатор должен знать принципы работы поисковых систем, без этого успешное продвижение невозможно.

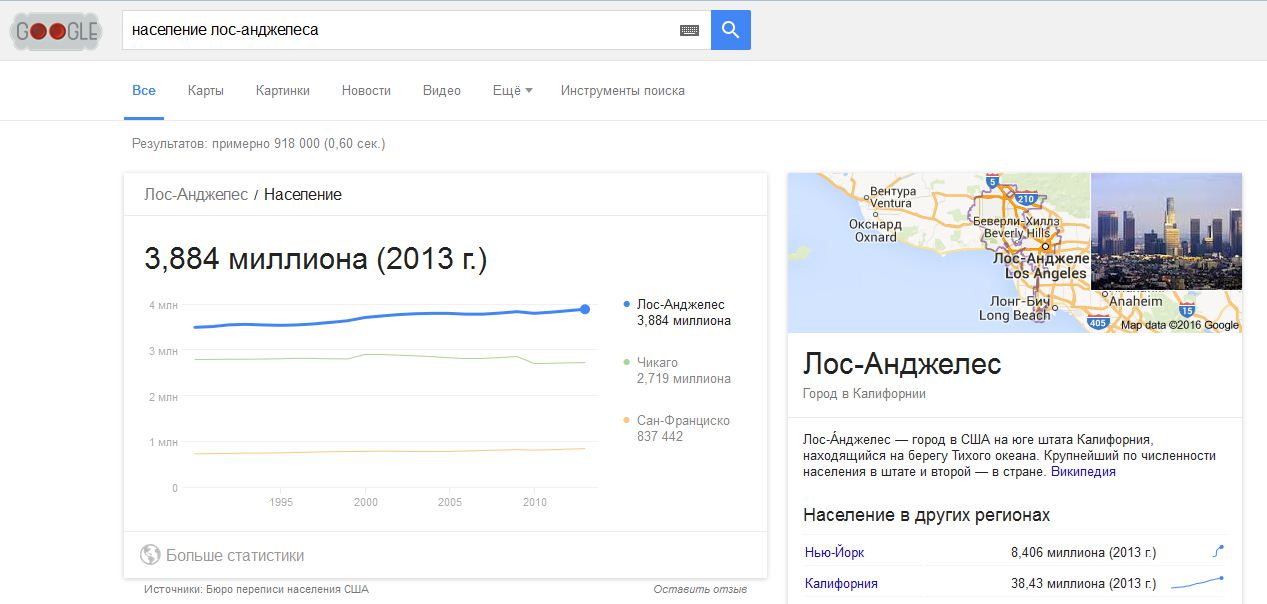

Сегодня поисковые системы могут давать ответ на некоторые запросы прямо в поисковой выдаче, правда, для этого они все равно используют сторонние источники информации:

Большинство пользователей не задумываются о том, как работают поисковые системы, да им это и не нужно. Им нужно быстро получить правильный ответ на свой запрос.

Крупнейшие поисковые системы

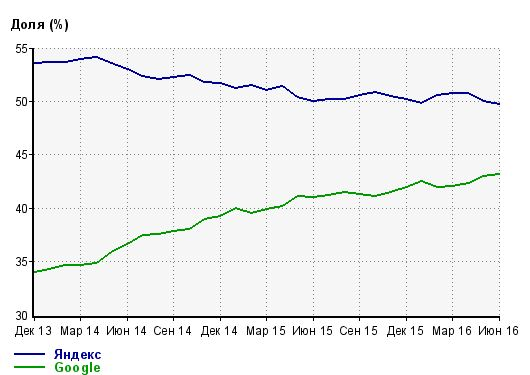

В Рунете лидерами являются Яндекс и Google. На долю первого приходится около 50 процентов, на долю второго около 43 процентов. Замечу, что в последние годы Google догоняет Яндекс. Еще в начале 2015 на долю Яндекса приходилось более 55%, а Google довольствовался 35-36 процентами.

Вот данные сервиса liveinternet.ru.

На третьем месте находится Mail.ru, его доля около шести процентов. На долю остальных приходится такое незначительно количество поисковых запросов, что их даже не стоит упоминать. Если брать весь мир, то тут первенство Google неоспоримо, ближайшие преследователи находятся очень далеко. Данные портала netmarketshare.com.

Принципы работы поисковой системы

Сегодня поисковые системы работают по одинаковым принципам, которые отличаются лишь в деталях. Сама работа строиться поэтапно:

- Поисковый робот ищет новые страницы в сети и сообщает о них индексатору;

- Робот добавляет страницу в базу и формирует индекс, который необходим для ее быстрого поиска в базе. Если страница низкого качества, то ее могут не проиндексировать.

- Поисковая система в ответ на запрос пользователя ищет в базе данных подходящие документы и формирует выдачу, где на первые места ставятся наиболее релевантные страницы.

Когда человек занимается продвижением сайта, у него есть возможность повлиять только на первый и последний этапы. Второй этап – это внутренняя кухня поисковой системы, достоверных данных о которой нет, известны только общие принципы. В данном случае, индексатор – это отдельный модуль, который разбивает страницу на части и анализирует ее, используя собственные алгоритмы. Это необходимо для того, что бы страница попала в базу и в последствии была легко и быстро найдена, так как ПС ищет ответ на запрос именно в своей базе.

Как поисковые системы формируют выдачу?

ПС используют сотни параметров для формирования релевантной выдачи. Некоторые параметры влияют позитивно, а некоторые негативно. Если писать все известные факторы, получится очень длинный список, да и я поговорю об этом подробно в других статьях. Но при определении релевантности страницы, поисковые системы обращают внимание на следующие факторы:

- Контент на странице (его качество и соответствие запросу);

- Ссылочные;

- Поведенческие;

- Возраст домена и url-страницы.

Работа асессоров

Алгоритм любой поисковой системы не является статичным, он постоянно обновляется и обучается. Помогают ему в этом асессоры – люди, которые смотрят выдачу по разным запросам и оценивают ее качество. Если от них поступает очень много замечаний, алгоритм ранжирования могут изменить очень сильно.

Если вы видите, как по очень популярному запросу в топе оказался сайт, которого там явно быть не должно, рано или поздно это увидят асессоры и он оттуда пропадет. А модель алгоритма исправят таким образом, что бы в будущем такие случаи не повторялись. У поисковых систем есть ошибки, и они будут, для этого и нужны люди, которые могут их выявлять.

Фильтры поисковых систем

Фильтры поисковых систем облегчают им работу и также влияют на формирование выдачи. Фильтр может быть наложен на отдельную страницу или на весь сайт в целом. Последнее делается тогда, когда все очень плохо с самим сайтом и ПС не считает нужным тратить вычислительные мощности на заведомо плохой проект.

Яркий пример – фильтры Панда и Пингвин у Google. Про второй я уже писал выше, Пингвин наказывает за внешние ссылки, а вот Панда смотрит на качество самого сайта. Google стало не интересно разбираться в том, какие страницы на сайте достойны быть в выдаче на высоких местах, а какие нет. При достижении определенного критического порога, фильтр накладывается на весь сайт.

Подробнее о фильтрах я поговорю в других статьях, здесь отмечу то, что часто они имеют решающее влияние на ранжирование сайта. Просто потому, что могут исключить его из выдачи.

Обман поисковых систем

Точные формулы своих алгоритмов ПС не публикуют, просто для того, что бы ими не пользовались для легкого попадания на первые места выдачи. Хотя, есть мнение, что даже знание всех формул хоть и даст преимущество, но не будет решающим фактором успеха. Алгоритмы слишком сложны и учитывают массу параметров.

Однако всем известны факторы ранжирования, на которые можно повлиять. Это может быть покупка ссылок, накрутка поведенческих факторов, злоупотребление ключевыми словами. ПС постоянно закручивают гайки, наказывая тех, кто излишне рьяно и неумело пользуется этими способами.

Тем не менее, пока будут работать параметры алгоритма, на которые можно повлиять, оптимизаторы будут это делать. Ведь первые места в выдаче для коммерческих сайтов – это большие деньги.

Рекомендую:

Если хотите получить перспективную профессию или освоить новый навык (будь то SEO, HTML, веб-программирование или даже мобильная разработка), то посмотрите ТОП-3 лучших онлайн школ:

- Нетология — одна из старейших школ интернет-профессий. Основные направления — маркетинг, управление, дизайн и программирование;

- GeekBrains — специализируется, в первую очередь, на обучении программистов. После интеграции в Mail Group появились и другие профессии;

- SkillBox — наиболее молодая из 3-х перечисленных школ, но обладает наибольшим ассортиментом специальностей. Если услышали о какой-либо экзотической профессии, то наверняка этому уже обучают в Skillbox.

Эти школы выдают дипломы и помогают с трудоустройством, а если вам нужно просто научиться что-то делать для себя больше как хобби, то рекомендую начать с бесплатных курсов, они позволят получить общее представление о профессии и первый практический опыт.

Сообщить об ошибке

Сообщить об ошибке